脳で想像したものと「同じ意味」の画像を表示

頭蓋内脳波を使い想像によって画像を制御する新技術

研究成果のポイント

- ヒトが画像(例:風景・文字)を想像することで、同じ意味の画像を画面に表示する技術を開発した

- ヒトが画像を見ながら別の画像を想像した場合の脳活動を明らかにし、想像した画像の意味内容を推定できることを示した

- ヒトの想像を映像として伝達する新しいコミュニケーションツールの実現可能性を初めて示した

概要

大阪大学大学院医学系研究科の福間良平特任助教(常勤)、大阪大学高等共創研究院 栁澤琢史教授らの研究グループは、被験者が見た画像の意味(例:風景・文字)を頭蓋内脳波から推定する脳情報解読技術を開発しました。また、この技術を用いることで、被験者が想像した意味の画像を画面に表示できることを世界で初めて示しました(図1)。

画像を見ている際の脳活動は、見ている画像の色や形、意味だけでなく、見ている人の注意や想像によって影響を受けることが知られています。先行研究では、脳活動をAIで解読することで、ヒトが見た画像を推定できることが示されています。また、目を閉じた状態で想像した画像を脳信号から推定できることも報告されています。しかし、ヒトが画面を見ながら異なる画像を想像することで、想像した意味の画像を画面に表示できるかは明らかでありませんでした。

今回、栁澤教授らの研究グループは、頭蓋内脳波から被験者が見た画像の意味内容を推定する脳情報解読器を作成しました。この脳情報解読器を用いて推定された意味内容の画像を画面に提示したところ、被験者が特定の意味の画像を想像することで、被験者が画面を見ながらでも想像している意味の画像を画面に表示できることを明らかにしました。さらに、ヒトが画像を見ながら別の意味の画像を想像する際の脳活動の特徴を明らかにしました。これらの成果により、ヒトの想像を映像として伝達する新しいコミュニケーションツールの実現可能性が初めて示されました。

本研究成果は、英国科学誌「Communications Biology」に、3月18日(金)午後7時(日本時間)に公開されました。

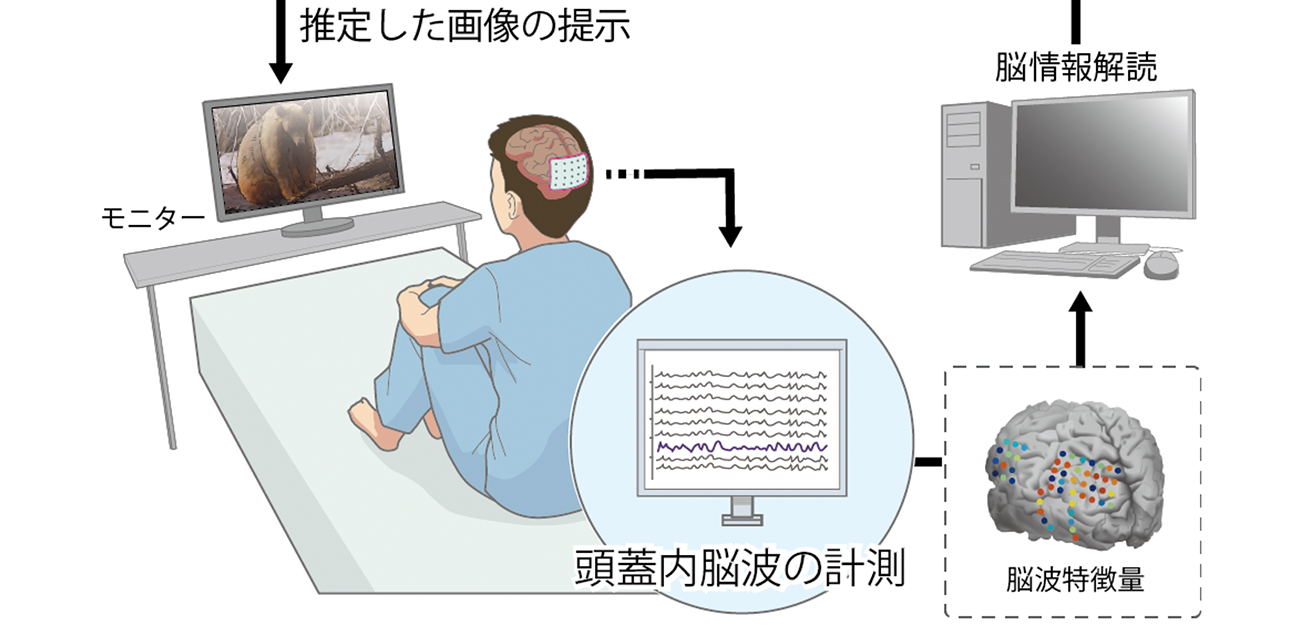

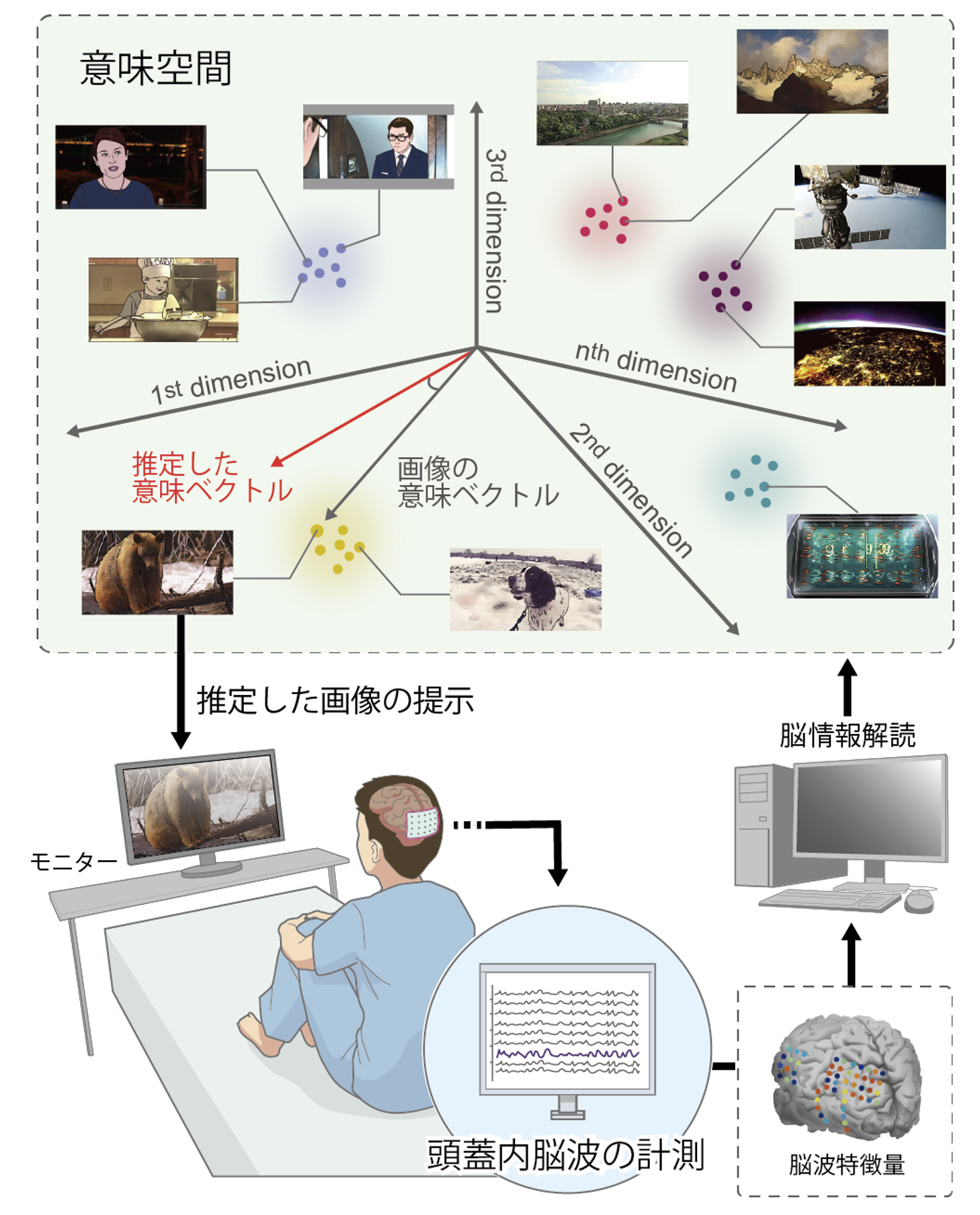

図1. 開発した脳情報解読・制御システム

ベッドもしくは椅子に座った被験者から計測した頭蓋内脳波から、意味空間を用いた脳情報解読により画像を推定する。推定した画像は直ちに被験者の前に置かれたモニターに表示される。

研究の背景

ヒトが風景や人の顔などの画像を見ると、眼から入った視覚情報が脳の視覚野と呼ばれる領域に伝えられ、画像の形や色、意味などに応じて様々な脳神経活動が生じます。さらに、ヒトが目を閉じて同じ画像を想像すると、画像を見ていた時と同様の活動が起こることが知られています。これらの視覚野の脳神経活動をfMRIなどで計測しAI技術を適応することで、ヒトが見たり想像した画像を再構成できることが先行研究により示されています(Shen et al., PLoS Comput. Biol. 2019)。また、画像を見ている場合の視覚野の脳活動は、見ている人の注意や想像によって影響を受けることが知られています。例えば、共同研究者である京都大学情報学研究科 神谷之康教授らは、2枚の重ね合わせた画像の片方に被験者が注意を向けた時に、どちらの画像に注意が向けられているかにより再構成された画像が変化することを示しています(Horikawa et al., Comm. Biol. 2022)。将来的に、このような技術は重度麻痺で意思伝達が困難な患者さんの意思を画像として伝えるコミュニケーションツールとして活用されることが期待されています。

しかし、ヒトが想った通りの画像を画面に表示できているかを確認するために画面を見ると、画面を見たことにより脳活動が変化して想像した内容をうまく表示できないかもしれません。また、画像を見ながら違う画像を想像した場合にどのような脳活動が生じるかは明らかになっていませんでした。そこで我々は、ヒトが画像を見ているときでも、別の画像を想像することで、脳活動から推定した画像が想像した内容に応じて制御できるか検証しました。

研究の内容

本研究グループでは、大阪大学大学院生命機能研究科の西本伸志教授と共同で、言語モデルを用いて、頭蓋内脳波からヒトが見ている画像の意味内容を推定する脳情報解読技術を開発しました。この技術は言語モデルをWikipediaにある大量の文章から学習し、学習した言語モデルの意味空間内で脳情報解読を行うものです。この技術を用いた脳情報解読の精度を評価するために、大阪大学大学院医学系研究科脳神経外科 貴島晴彦教授、順天堂大学脳神経外科 菅野秀宣先任准教授、奈良県立医科大学脳神経外科 田村健太郎講師らの協力のもと、てんかんなどの治療目的で視覚野周辺に頭蓋内電極を留置された17人の被験者が動画を視聴した際の頭蓋内脳波を計測しました。実験に用いた60分の動画には、風景、動物、文字、ヒトといった様々な意味内容が含まれています(図1、意味空間内イラスト)。計測した頭蓋内脳波を解析したところ、被験者が視聴している動画の意味内容が頭蓋内脳波から推定できることが明らかになりました(風景、文字、人の顔の画像をそれぞれ約70%の精度で識別)。

さらに、本研究グループでは、同技術を用いてヒトが想像することによって画像を表示するシステムを開発しました(図1)。画像制御実験では、頭蓋内脳波を計測されている4人の被験者に、頭蓋内脳波から推定された画像を250msごとに画面に提示しました。次に、被験者には、ランダムな順番で3つの指示(風景・文字・人の顔)を与え、それぞれが意味する画像を想像して、同じ意味の画像を画面に提示するように指示しました(図2)。すると、すべての被験者について、指示された意味の画像が偶然で起こる場合よりも高い確率で表示されました(図3、風景・文字・人の顔のそれぞれについて55~74%の精度)。これにより、被験者が想像することで、想像したカテゴリの画像(風景・文字・人の顔)を表示できることが明らかになりました。

また、本研究グループでは、被験者がある意味の画像を見ながら別の意味の画像を想像した時にどのように脳活動が変化しているかを明らかにするために、認知・想像実験を行いました。この実験では、被験者が(1)画像を見ている時と(2)他の画像を想像しながら見ている時の頭蓋内脳波を13人の被験者から計測しました。結果、被験者がある意味の画像を見ながら別の意味の画像を想像した時、視覚野の脳活動が想像した意味の画像を実際に見た場合の脳活動に近づくことを発見しました(図4)。 これらのことから、画像制御実験中には、被験者は画像を想像することで、視覚野の脳活動を変化させて画面に表示する画像を変えていた(制御していた)ことが示唆されました。

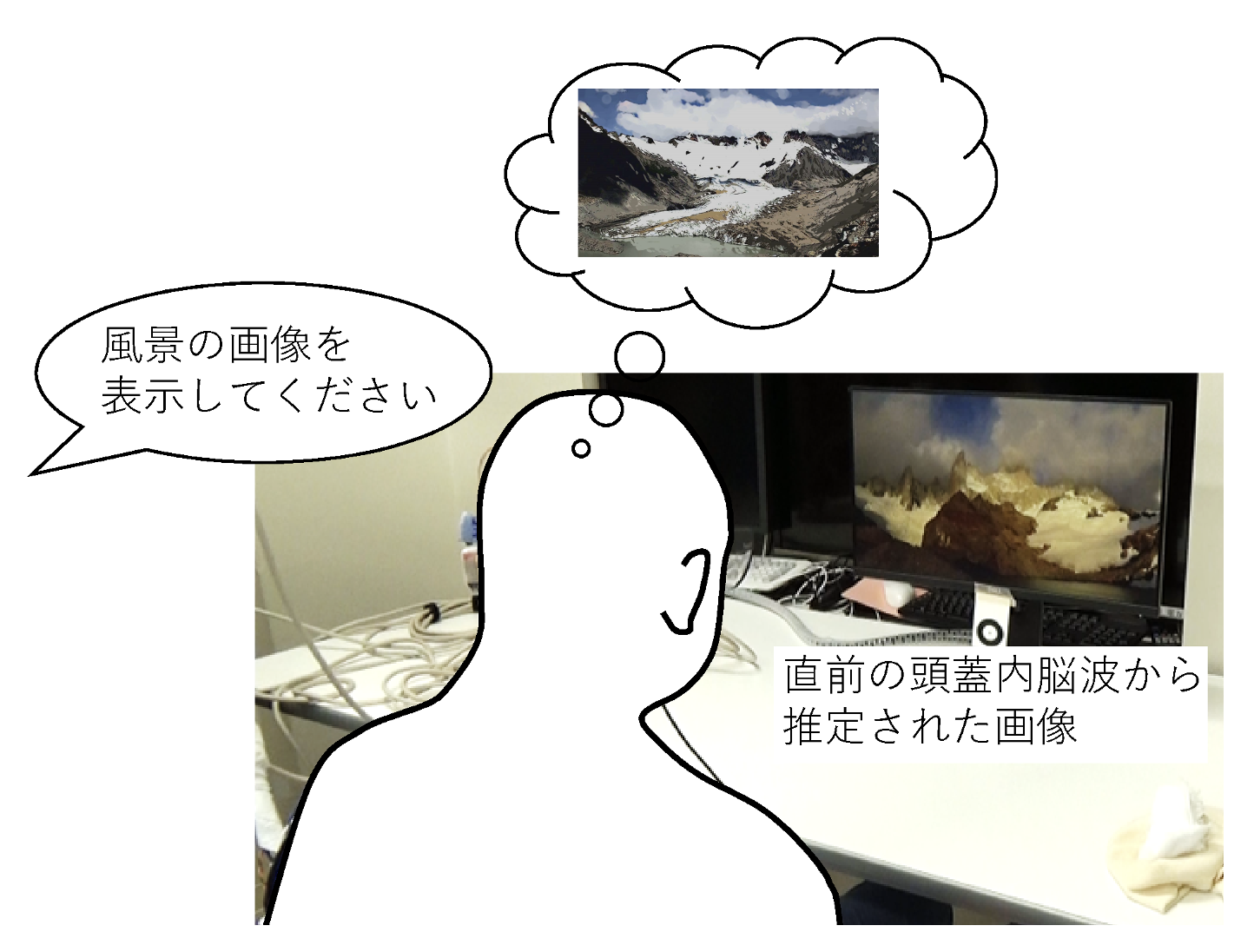

図2. 画像制御実験の様子

実験中に被験者は風景・文字・人の顔のうちから1つの指示が音声で与えられた。被験者は指示された意味の画像を視覚的に想像することで、前に置かれたモニターに指示された意味の画像を表示するように試みた。

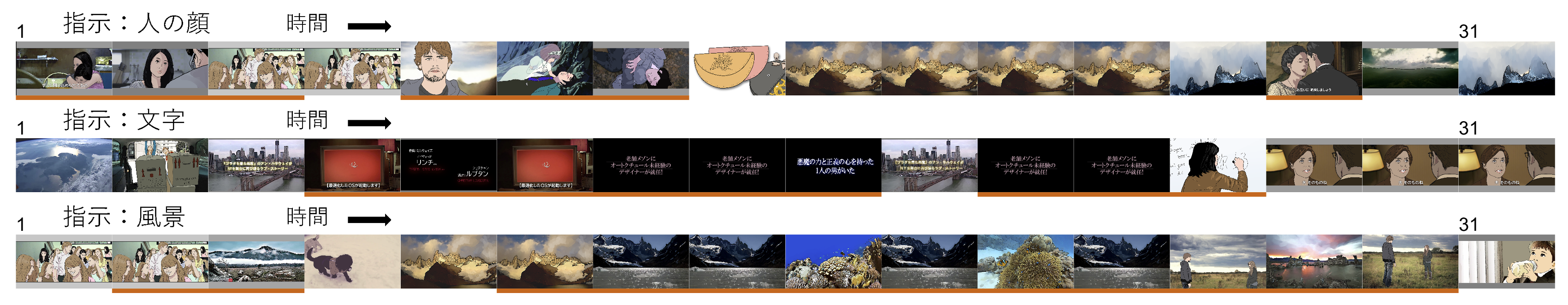

図3. 画像制御実験の結果

実験では1回の指示に対して250msごとに計32枚の推定画像を表示した。この時に表示された画像を1枚おきに左から右に並べた。赤下線部が指示に対して正答となったところ。

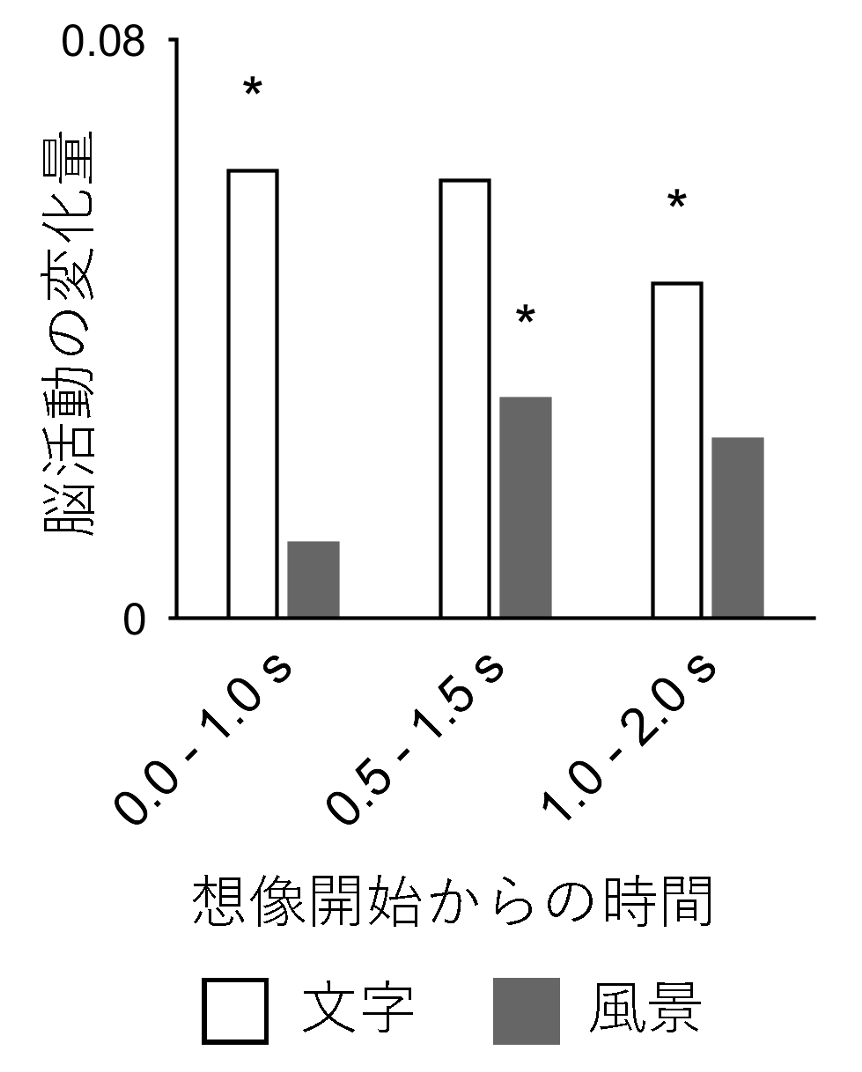

図4. 認知・想像実験の結果

各棒グラフが高いほど、ある画像を想像しながら違う画像を見ている時の脳活動が、想像している画像を実際に見た時の脳活動に近くなっていることを示す。白と黒の棒グラフはそれぞれ想像している画像のカテゴリが文字と風景であった場合を示す。(*5%有意)

本研究成果が社会に与える影響(本研究成果の意義)

本研究成果は、ヒトが画像を見ながら別の画像を想像したときの脳神経活動を明らかにし、想像に基づいた画像選択を実証する事で、想像のメカニズムを解明する重要な知見と手法を示しました。また、頭蓋内脳波から脳情報解読をすることで、ヒトが想像した意味の画像を画面に提示できる新技術は、様々な応用が期待されます。つまり、想像することで画像を検索・生成する新しい情報通信技術や、重度麻痺により意思伝達が困難な方が、視覚的想像に基づいて画像を提示して意思伝達を行う新しいコミュニケーションツールへの応用が期待されます。

特記事項

本研究成果は、2022年3月18日(金)午後7時(日本時間)に英国科学誌「Communications Biology」(オンライン)に掲載されました。

タイトル:“Voluntary control of semantic neural representations by imagery with conflicting visual stimulation”

著者名:Ryohei Fukuma,1,2,3 Takufumi Yanagisawa,1,2,3,4,* Shinji Nishimoto,5,6 Hidenori Sugano,7 Kentaro Tamura,8 Shota Yamamoto,1 Yasushi Iimura,7 Yuya Fujita,1 Satoru Oshino,1 Naoki Tani,1 Naoko Koide–Majima,5,6 Yukiyasu Kamitani,2,9 and Haruhiko Kishima1,4 (*責任著者)

所属:

1. 大阪大学 大学院医学系研究科 脳神経外科

2. ATR脳情報研究所

3. 大阪大学 高等共創研究院

4. 大阪大学医学部附属病院 てんかんセンター

5. 情報通信研究機構

6. 大阪大学 大学院生命機能研究科

7. 順天堂大学 脳神経外科

8. 奈良県立医科大学 脳神経外科

9. 京都大学大学院 情報学研究科

DOI:https://doi.org/10.1038/s42003-022-03137-x

本研究は、JST戦略的創造研究推進事業CREST研究(共生インタラクション、脳表現空間インタラクション技術の創出、JPMJCR18A5)の一環として行われ、大阪大学大学院生命機能研究科の西本伸志教授、順天堂大学脳神経外科 菅野秀宣先任准教授、奈良県立医科大学脳神経外科 田村健太郎講師、京都大学情報学研究科 神谷之康教授、大阪大学大学院医学系研究科脳神経外科 貴島晴彦教授らの協力を得て行われました。

参考URL

福間良平特任助教(常勤) 研究者総覧

https://rd.iai.osaka-u.ac.jp/ja/865ef361863667f4.html

栁澤琢史教授 研究者総覧

https://rd.iai.osaka-u.ac.jp/ja/ed99bce9a1d58f9e.html

大阪大学 高等共創研究院 栁澤研究室 webサイト

https://www.med.osaka-u.ac.jp/pub/nsurg/yanagisawa/

CREST脳表現空間インタラクション技術の創出

https://www.med.osaka-u.ac.jp/pub/nsurg/yanagisawa/CREST/

用語説明

- 頭蓋内脳波

脳の表面もしくは深部に留置した電極(頭蓋内電極)で計測した脳波。本研究では難治性てんかんの患者さんらに協力していただいて計測を行った。高い時間分解能(本研究では1秒間に10,000回の計測)を持ち、脳表の広い範囲から計測されるという特徴がある。

- 脳情報解読

脳信号に機械学習を適用することで、被験者の認知内容や意図を推定する技術。

- 視覚野

脳の後方に位置し、視覚情報の処理を行う脳の部位。

- fMRI

強力な磁場を用いて脳内の血流変化を計測する方法。高い空間分解能で全脳の活動を計測できる。

- 再構成

ヒトが見ている画像を機械学習手法の1つであるDeep Neural Networkなどを用いて推定して作り出すことを示す。

- 言語モデル

言語情報をベクトルに変換するモデル。本研究では、文章中の単語(名詞・動詞・形容詞)を1,000次元のベクトルに変換するword2vecモデルを使用した。word2vecモデルによって、単語から変換されたベクトルを用いると、ベクトル間の足し算や引き算が、単語の意味関係と似た性質を持つことが知られている。(例: 王 – 男性 + 女性 = 女王)

- 意味空間

言語モデルにより変換された単語のベクトルがとる空間。