AIネットワーク化が進展する社会に求められる法整備

―誰もが安心して公平に使える社会に向けて―

法学研究科・教授・福田雅樹

総務省の官僚としてAI(人工知能)を巡る諸問題に取り組んできた、大阪大学大学院法学研究科の福田雅樹教授は、AIのネットワーク化が進展する社会に必要な法整備などについて研究している。福田教授は、ネットワーク化が進展する社会を考える上でのキーワードとして「包摂」を挙げた。その意味することとは。

AIネットワーク化された国際社会を見据えて

AIの評価は人によってさまざまだ。福田教授は「AIはまだまだ不安要素も多いが、負の面にしっかりと対応できれば、世の中にとってプラスになる」と考える。

AIは、他のシステムと連携させずに単独でも利用できるが、ネットワークにつながっていれば、より多様な情報を得ることができる。インターネットだけでなく、センサーから入ってくる世の中のリアルなデータもIoT(モノのインターネット)を通じて流通する。入力が多いほどAIは機械学習をして性能がさらに高まり、出力先も時には国境を越え、その便益はグローバルになる。これがAIネットワーク化だ。分かりやすい例としては、インターネット上の検索サービス。膨大な検索対象を人の手で一つ一つ調べることは事実上不可能であり、ネットワークにつながった多くのシステムから得られるデータを大量に扱えるAIだからこそできるものだ。

ただし、AIネットワーク化社会ではプライバシーの侵害などのリスクが格段に高いのは言うまでもなく、そのリスクは当然グローバルな問題となる。リスクに対応するため、何が検討されるべきか、どういった規範を設けるべきなのか、あるいは設ける必要がないのか。AIネットワーク化が進展する国際社会を視野に入れて考える。福田教授のまさに研究テーマだ。

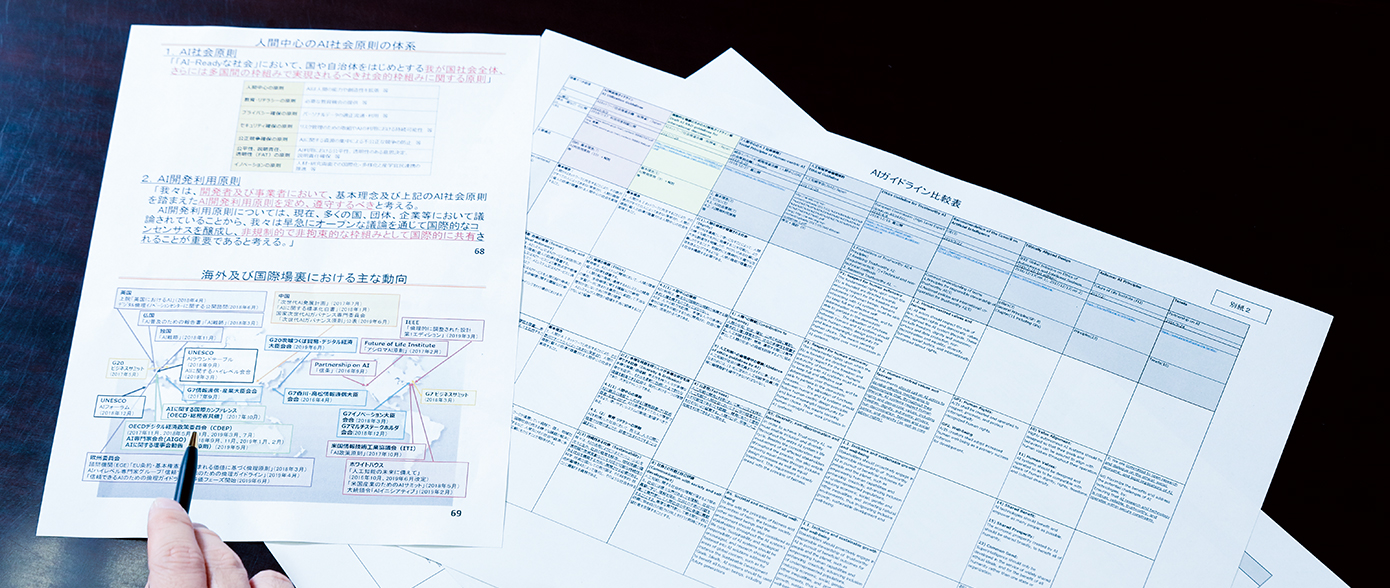

国際的な議論は始まったばかり

福田教授は総務省で、AIの開発及び利用に関する国際的なガイドラインの策定に奔走してきた。2016年、G7香川・高松情報通信大臣会合でAIに関する国際的な原則策定に向けた検討が始まり、2019年5月にOECDがガイドラインを策定、同年6月のG20大阪においてOECDガイドラインに基づく原則が首脳レベルで承認された。AI利用によって問題が起きた(起きることが予想される)場合、共通認識をもとに国際的に対策を検討する土壌がようやくできたといえる。今後は、その具体化を進めることが国際的な課題となるほか、国際的な規範を反映した規範を形成することが国内的な課題となる。

AIネットワーク化のリスクに関しては、リスクの「適切な」管理が重要だという。「適切な」とは、「ゼロリスク」ではなく、社会的に受容できるものかどうかがポイントとなる。なぜなら「ゼロリスク」は利便性を放棄することになり得るからだ。AIネットワーク化を進めるためには、AIの開発者、AIを提供する企業、AIを活用する企業や個人など関係者が広く共有できる規範が必要だ。「AI利用に関する考え方は人それぞれ。その中から論点を多角的に抽出し、AIをめぐる規範の体系を検討していくことに注力してきました」

配慮すべきは「包摂」

AIの判断は、開発時や利用時に用いられたデータ次第である。データが社会に現に存在する不平等、性差などの偏りを反映するものであれば、AIの判断も偏りを反映したものとなる。社会に存在する偏りを反映した判断が不当に活用されると、社会で不利な状況にある者が不当に不利に取り扱われ、その社会への参画が不当に妨げられることにつながるおそれがある。

また、今後は、商品やサービス、さまざまな社会のシステムにおいて、AIネットワークを利用することが前提になっていく可能性が高い。その際、誰でも安心して安全に使える環境を整備しておかなくては、人と人とのつながりに入ることが妨げられ、社会に参画できない層を生み出してしまうことになる。AIネットワークの中でも、必需性の高いものは、誰もが手頃で公平な条件で安心して安全に使えるものにすることが特に重要だ。

「AIネットワーク化を進めていく上で、社会を構成する人々を『包摂』(誰一人取り残さないこと)することを決して忘れてはいけない」と語る福田教授の声には、穏やかな凄みがあった。

福田教授

自分が決めた「視座」から研究対象及びその取り巻く環境の双方をつぶさに見続ける。その見え方を他のさまざまな視座からの見え方とも組み合わせ、研究対象の見え方をブラッシュアップしていく営みだと思います。

●福田 雅樹(ふくだ まさき)

1994年京都大学法学部卒業、2007年東京大学大学院学際情報学府修了、博士(学際情報学)。郵政省、早稲田大学准教授、総務省情報通信政策研究所などを経て、17年8月より現職。

(2020年2月取材)